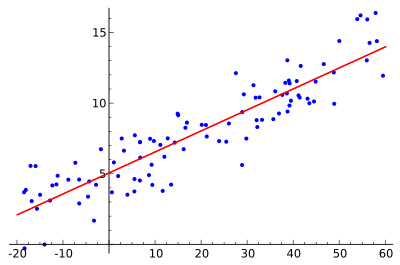

Regresia liniară este o modalitate de a observa modul în care se schimbă ceva atunci când alte lucruri se schimbă folosind matematica. O regresie liniară utilizează o variabilă dependentă și una sau mai multe variabile explicative pentru a crea o linie dreaptă. Această linie dreaptă este cunoscută sub numele de "linie de regresie".

Regresia liniară a fost prima dintre numeroasele modalități de efectuare a analizei de regresie. Acest lucru se datorează faptului că modelele care depind în mod liniar de parametrii lor necunoscuți sunt mai ușor de ajustat decât modelele care sunt legate în mod neliniar de parametrii lor. Un alt avantaj al regresiei liniare este acela că proprietățile statistice ale estimatorilor rezultați sunt mai ușor de determinat.

Regresia liniară are multe utilizări practice. Cele mai multe aplicații se încadrează într-una dintre următoarele două mari categorii:

- Regresia liniară poate fi utilizată pentru a ajusta un model predictiv la un set de valori observate (date). Acest lucru este util, dacă obiectivul este predicția, prognoza sau reducerea. După dezvoltarea unui astfel de model, dacă se dă apoi o valoare suplimentară a lui X fără valoarea y care o însoțește, modelul ajustat poate fi utilizat pentru a realiza o valoare prezisă a lui y (scrisă ca

).

- Având în vedere o variabilă y și un număr de variabile X1 , ..., Xp care pot fi legate de y, analiza de regresie liniară poate fi aplicată pentru a cuantifica intensitatea relației dintre y și Xj , pentru a evalua care Xj nu are nicio relație cu y și pentru a identifica ce subansambluri ale Xj conțin informații redundante despre y.

Modelele de regresie liniară încearcă să facă ca distanța verticală dintre linie și punctele de date (adică reziduurile) să fie cât mai mică posibil. Acest lucru se numește "adaptarea dreptei la date". Adesea, modelele de regresie liniară încearcă să minimizeze suma pătratelor reziduurilor (cele mai mici pătrate), dar există și alte modalități de ajustare. Acestea includ minimizarea "lipsei de potrivire" într-o altă normă (ca în cazul regresiei cu cele mai mici abateri absolute) sau minimizarea unei versiuni penalizate a funcției de pierdere a celor mai mici pătrate, ca în cazul regresiei ridge. Abordarea celor mai mici pătrate poate fi utilizată și pentru a ajusta modele care nu sunt liniare. După cum s-a subliniat mai sus, termenii "cele mai mici pătrate" și "model liniar" sunt strâns legați, dar nu sunt sinonime.